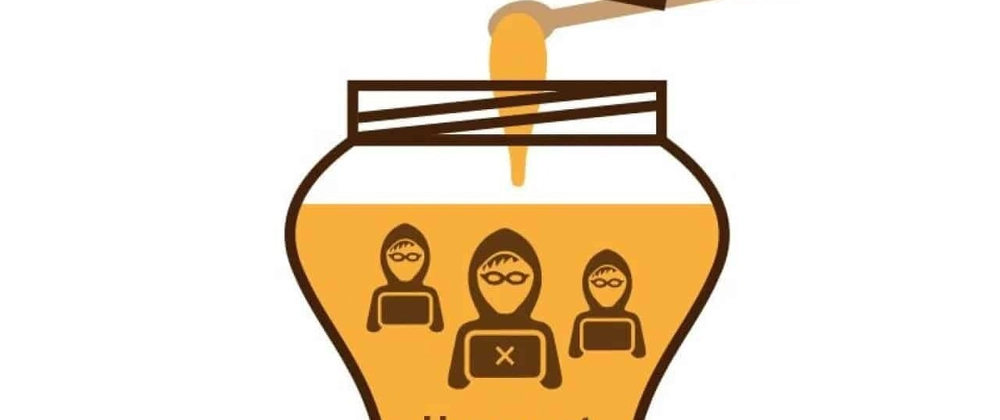

Bien sûr ! La technique du "honeypot" (littéralement "pot de miel") est une méthode de protection contre les spams. C'est une solution intelligente et non intrusive qui repose sur l'idée de créer un "piège" spécifique pour les robots spammeurs. Voici une explication plus détaillée :

Comment ça fonctionne ?

-

Ajout de champs cachés : Dans un formulaire (par exemple, un formulaire de commentaire ou d'inscription), vous ajoutez un ou plusieurs champs supplémentaires, comme "email_confirm" ou "extra_field".

- Ces champs sont rendus invisibles pour les utilisateurs humains en utilisant du CSS, comme :

.honeypot { display: none; visibility: hidden; }Les humains ne voient donc pas ces champs.

Les robots remplissent tout : Les robots spammeurs, lorsqu'ils analysent le HTML de la page, ne tiennent pas compte du CSS. Ils détectent et remplissent automatiquement tous les champs, y compris les champs cachés.

Détection de spam : Du côté serveur, vous vérifiez si l'un des champs cachés est rempli. Si c'est le cas, cela indique que c'est un robot qui a soumis le formulaire, et la requête est rejetée comme spam.

Pourquoi est-ce efficace ?

- Les humains n'interagissent pas : Les utilisateurs humains ne peuvent pas interagir avec ces champs cachés puisqu'ils ne les voient pas.

- Simple et rapide : C'est facile à mettre en place et ne nécessite pas d'outils complexes comme les CAPTCHAs, qui peuvent être frustrants pour les utilisateurs.

Exemple en Laravel :

Voici comment vous pourriez implémenter cette technique en Laravel :

- Ajout d'un champ dans le formulaire :

<input type="text" name="honeypot_field" class="honeypot" />

- Vérification dans le contrôleur :

public function store(Request $request)

{

if ($request->filled('honeypot_field')) {

// C'est un robot, rejetez la requête

return response('Spam detected', 400);

}

// Continuer avec le traitement normal

}

Les avantages :

- Invisible pour les utilisateurs : Contrairement aux CAPTCHAs, cela n'ajoute aucune friction pour les humains.

- Aucun coût supplémentaire : Pas besoin d'utiliser de services tiers.

- Discret mais puissant : Très efficace contre les robots basiques.

Les limites :

- Certains robots plus avancés ignorent les champs invisibles en CSS et peuvent contourner cette technique. Dans ces cas, il pourrait être nécessaire d'ajouter des mesures supplémentaires comme des CAPTCHAs ou des vérifications sur le serveur.

Top comments (0)